Nowe publikacje

Kardiolodzy przeszkolili duży model sztucznej inteligencji do oceny struktury i funkcji serca

Ostatnia recenzja: 02.07.2025

Cała zawartość iLive jest sprawdzana medycznie lub sprawdzana pod względem faktycznym, aby zapewnić jak największą dokładność faktyczną.

Mamy ścisłe wytyczne dotyczące pozyskiwania i tylko linki do renomowanych serwisów medialnych, akademickich instytucji badawczych i, o ile to możliwe, recenzowanych badań medycznych. Zauważ, że liczby w nawiasach ([1], [2] itd.) Są linkami do tych badań, które można kliknąć.

Jeśli uważasz, że któraś z naszych treści jest niedokładna, nieaktualna lub w inny sposób wątpliwa, wybierz ją i naciśnij Ctrl + Enter.

Eksperci od sztucznej inteligencji z Cedars-Sinai i Smidt Heart Institute stworzyli zbiór danych obejmujący ponad 1 milion echokardiogramów (wideo USG serca) i ich odpowiednie interpretacje kliniczne. Korzystając z tej bazy danych, opracowali EchoCLIP, potężny algorytm uczenia maszynowego, który może „interpretować” obrazy echokardiogramów i oceniać kluczowe wskaźniki.

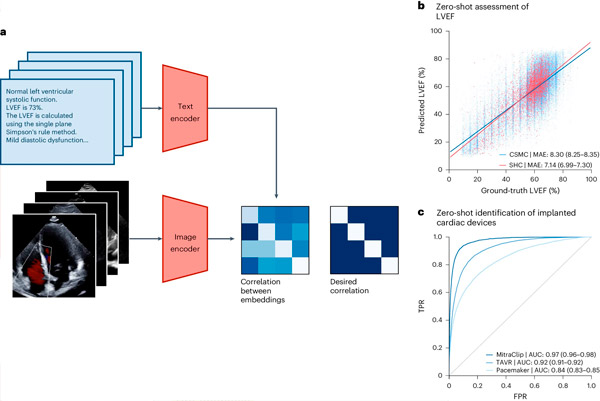

Konstrukcja i ocena EchoCLIP, opisane w artykule opublikowanym w czasopiśmie Nature Medicine, wskazują, że interpretacja echokardiogramu pacjenta z wykorzystaniem EchoCLIP pozwala na przeprowadzenie oceny klinicznej na poziomie specjalistycznym, obejmującej ocenę funkcji serca, wyników poprzednich operacji i wszczepionych urządzeń, a także może pomóc lekarzom w identyfikacji pacjentów wymagających leczenia.

Model bazowy EchoCLIP umożliwia także identyfikację tego samego pacjenta na podstawie wielu nagrań wideo, badań i punktów czasowych, a także rozpoznanie klinicznie istotnych zmian w sercu pacjenta.

„Według naszej wiedzy jest to największy model wytrenowany na obrazach echokardiograficznych ” – powiedział główny autor badania, dr David Ouyang, członek wydziału Kardiologii w Instytucie Serca Smidta i Wydziału Sztucznej Inteligencji w Medycynie.

„Wiele poprzednich modeli AI dla echokardiogramów jest trenowanych na zaledwie dziesiątkach tysięcy przykładów. Natomiast wyjątkowo wysoka wydajność EchoCLIP w interpretacji obrazu jest wynikiem trenowania na prawie dziesięciokrotnie większej ilości danych niż w przypadku istniejących modeli”.

„Nasze wyniki pokazują, że duże zbiory danych obrazowania medycznego i interpretacje zweryfikowane przez ekspertów mogą służyć jako podstawa do szkolenia podstawowych modeli medycznych, które są formą generatywnej sztucznej inteligencji” – dodał Ouyang.

Przepływ pracy EchoCLIP. Źródło: Nature Medicine (2024). DOI: 10.1038/s41591-024-02959-y

Zauważył, że ten zaawansowany model bazowy może wkrótce pomóc kardiologom w ocenie echokardiogramów poprzez generowanie szacunków pomiarów serca, identyfikację zmian w czasie i powszechnych chorób.

Zespół badawczy stworzył zbiór danych 1 032 975 filmów z ultrasonografii serca i odpowiadających im interpretacji ekspertów, aby opracować EchoCLIP. Kluczowe ustalenia z badania obejmują:

- EchoCLIP wykazał wysoką skuteczność w ocenie funkcji serca na podstawie obrazów serca.

- Model bazowy pozwolił na identyfikację wszczepionych urządzeń wewnątrzsercowych, takich jak rozruszniki serca, implanty zastawek mitralnych i implanty zastawek aortalnych na podstawie obrazów echokardiogramu.

- Rozwiązanie EchoCLIP umożliwiało precyzyjną identyfikację unikalnych pacjentów w różnych badaniach, wykrywało klinicznie istotne zmiany, takie jak przebyte operacje kardiochirurgiczne, i umożliwiało opracowanie wstępnych interpretacji tekstowych obrazów echokardiogramów.

„Podstawowe modele są jednym z najnowszych obszarów generatywnej sztucznej inteligencji, ale większość modeli nie ma wystarczającej ilości danych medycznych, aby były przydatne w opiece zdrowotnej” — powiedziała dr Christina M. Albert, MPH, kierownik Oddziału Kardiologii w Smidt Heart Institute.

Albert, który nie brał udziału w badaniu, dodał: „Ten nowy model bazowy integruje wizję komputerową do interpretacji obrazu echokardiogramu z przetwarzaniem języka naturalnego w celu ulepszenia interpretacji kardiologów”.